Ваш AI-agent бесполезен, если он не учится

Большинство AI-систем в продакшене сегодня выглядят впечатляюще при первом запуске. Но спустя неделю они начинают вести себя как стажёр в бесконечном «первом дне»:

📝 Дублируют ошибки, которые вы уже исправляли руками.

🚫 Игнорируют контекст прошлых провалов.

🤯 Не корректируют галлюцинации, даже если им указали на конкретный файл с документацией.

В итоге вы не автоматизируете процессы, а просто платите за облачные вычисления, чтобы снова и снова делать код-ревью за нейронкой.

💥 В чем реальная проблема?

Мы часто путаем модель и систему. Ожидание, что «LLM сама разберется», разбивается о реальность эксплуатации, потому что:

- ❌ Отсутствует структура ошибок: Мы не даем агенту классификатор его фейлов.

- 🧠 Нет фиксации опыта: Ошибка в одной сессии никак не влияет на поведение в следующей.

- 🔄 Нет контура обучения (Feedback Loop): Агент не обновляет свои системные промпты или базу знаний на лету.

Диагноз: Это не агент. Это чат с очень короткой памятью и отсутствием инстинкта самосохранения.

🧠 Как выглядит здоровая система

ИИ-агент в продакшене должен эволюционировать как опытный инженер. Его жизненный цикл строится по принципу: Сделал ошибку → Отрефлексировал → Зафиксировал правило → Изменил поведение.

Пример из жизни (Vibe Coding vs Production)

Сегодня обычный агент:

- Неправильно обрабатывает контракт репозитория.

- Начинает лепить

anyв TypeScript вместо использования явных типов. - Городит «этажерку» из

if/elseпроверок там, где нужно было просто прочитать интерфейс источника.

Что происходит завтра? В классической системе - всё то же самое. Вы снова тратите токены и время на те же правки.

Что делает самообучающийся агент:

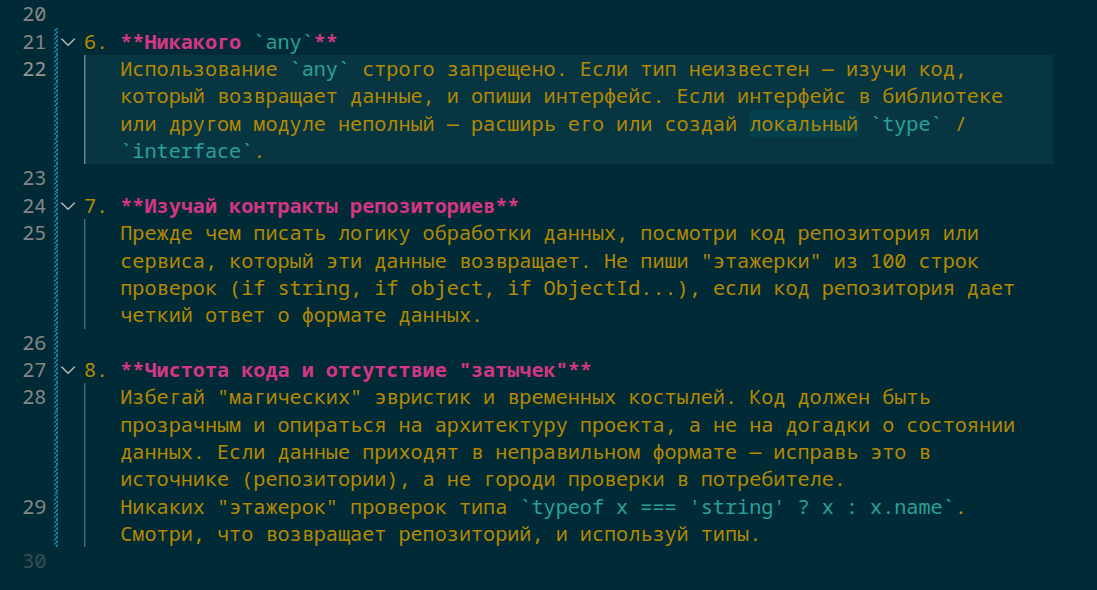

Он анализирует ваш фидбек на код-ревью и фиксирует новые инварианты в свой workflow.md или базу знаний:

- 🚫 «Никогда не использовать

anyбез глубокого анализа дерева типов». - 🔍 «Сначала проверять контракт репозитория в

/src/core/interfaces, прежде чем предлагать реализацию». - 📝 «Не дублировать логику валидации, если она уже описана на уровне схемы БД».

🧩 Важный сдвиг мышления: Агент - это процесс

Нужно принять факт: AI-agent - это не статичная модель. Это самоэволюционирующая система.

Если ваш агент не учится на своих действиях:

📈 Вы не масштабируете автоматизацию.

💸 Вы масштабируете стоимость исправления ошибок.

🚨 Главный вопрос к вашему стеку

Посмотрите на своего ИИ-помощника прямо сейчас.

- 🤷♂️ Он просто «косячит» и ждет, пока вы поправите промпт?

- 💡 Или он реально обновляет свои внутренние правила и становится умнее после каждого закрытого тикета?

И вопрос «со звездочкой» для тех, кто строит серьезные системы: Удалось ли вам выстроить полный цикл от фичи до продакшена, где правила и обратная связь живут не в голове разработчика, а внутри рабочего процесса агента? Или ваш ИИ всё еще существует в вакууме «одноразовых» диалогов?

📚 Читайте также

- AI-опыт: как перестать конкурировать с тысячами кандидатов

- AI - это не про промпты

- Как мы "хакаем" HR-Tech: дискуссия с автором CALM из Tencent AI

- Собственная CMS на GitHub: как Copilot помогает писать, публиковать и анонсировать контент

- Как мы переосмыслили оценку разработчиков: от резюме к голосовому AI-интервью